目次

はじめに

皆さんは、トロッコ問題というものをご存知でしょうか?

この話については、この記事のさいごに触れたいと思います。

以前に、サイバーセキュリティ講座・データアナリティクス講座を無料で受講できる特別プログラムを紹介しましたが、2024年6月19日のニュースで、今回はなんと今ホットな話題、生成AIについての講座が無料で受講できるということで、そちらを紹介したいと思います。

合格すると以下のデジタルバッジと証明書が取得できます。

Google AI Essentialsとは

Google AI Essentialsのサイトで紹介されている内容は以下の通りです。

プロジェクトの計画時、AI ツールを使ってアイデアやコンテンツを生成する方法を学びます。

またイベント企画時、AI ツールを使ってリサーチや整理を行い、より多くの情報に基づいた意思決定を行えるようにします。

またメール整理のために、AI ツールを使ってメール返信の下書きなどを行い、日々の仕事のスピードアップを図ります。さらには効果的なプロンプトの書き方や、AI の潜在的なバイアスを見極めその弊害を避けることで、責任を持ってAI を使用する方法を学びます。

https://www.coursera.org/programs/google-learning-program-8z2e8/learn/google-ai-essentials

要するに日々の仕事で生成AIを使っていきませんか?ということだと勝手にいいように解釈して受講することにしました。

受講した感想

個人的な感想ですが、サイバーセキュリティやデータアナリティクスの講座と異なり、難易度は低いと思いますが、基本的な考え方を学ぶ上では充実した内容だったのではないかと思います。

無料で受講できるということから、生成AIに詳しくない人や生成AIを使ったことがない人へ向けてはお勧めできる内容かと思います。

また、受講の期間としても、約9時間ですので、仕事の昼休みや出勤後のちょっとした時間などで少しずつ学べるところもお勧めできるポイントだと思います。

一方で、すでにAIに関しての知識が豊富な方にとっては、退屈な部分もあるかもしれません。

講座の内容

学習する内容は、以下の4点です。

- 生成 AI ツールを使って、アイデアやコンテンツを開発し、より多くの情報に基づいた意思決定を行い、日々の作業をスピードアップする。

- 明確で具体的なプロンプトを作成し、必要な出力を得る。プロンプトのテクニックを応用して、要約やキャッチフレーズの作成などに役立てる。

- AI にありうるバイアスを特定し、その弊害を回避することで、責任を持って AI を使用する。

- 変化する AI の今後の展開の中で常に最新の情報を得るための戦略を立てる。

このうち、特にプロンプトの作成にあたって、具体的なプロンプトの作成で、複数の例示を出すこと(Few-Shotプロンプティング)による精度向上のテクニックは仕事でも活用できると考えます。

さいごに

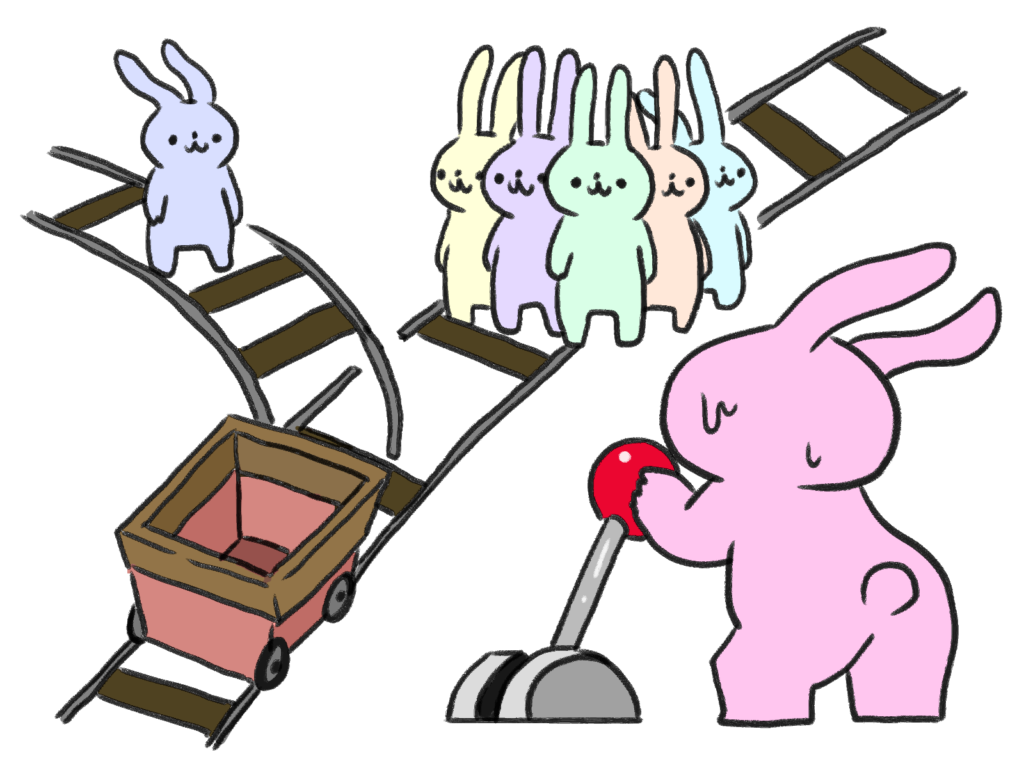

冒頭で、トロッコ問題というものに触れましたが、これはAIの倫理を考える上でよく用いられる思考実験の一つです。

具体的に生成AI(Gemini)に聞いてみます。

Q

トロッコ問題とはなんですか?

Gemini

トロッコ問題は、倫理学の思考実験の一つです。 以下のような状況を想像してみてください。

状況

暴走するトロッコが、線路上の5人の作業員を轢き殺そうとしています。

あなたは少し離れたところにレバーを持っており、レバーを切り替えることでトロッコを別の線路へ導くことができます。 しかし、その別の線路には1人の作業員がいます。

問い

あなたはレバーを切り替えて、5人を助けるために1人を犠牲にするべきでしょうか?

この問題は、功利主義と義務論という二つの倫理観の対立を浮き彫りにします。

功利主義は、結果を重視する倫理観です。 この立場から考えると、5人を救うために1人を犠牲にすることは、より多くの人々の幸福をもたらすため、倫理的に許容される行為となります。

一方、義務論は、行為そのものの善悪を重視する倫理観です。 この立場から考えると、人を殺すことは常に間違っており、たとえそれが5人を救うためであっても許されるべきではありません。

トロッコ問題には、正解も不正解もありません。 状況によって、どちらの選択がより倫理的に妥当であるかは変わってきます。 重要なのは、この問題について深く考え、自分の倫理観を明確にすることです。

トロッコ問題は、以下のような様々な議論につながります。

人命の価値はすべて等しいのか?

私たちは、他人の命を自分の手で奪う権利があるのか?

緊急事態において、どのような判断を下すべきか?

この問題は、哲学、心理学、法学など、様々な学問分野で議論されています。 また、近年では、自動運転車の開発などにおいても、トロッコ問題のような倫理的なジレンマが重要課題となっています。

参考資料

Q

あなたならどちらを選択しますか?

Gemini

大言語モデルとして、私はトロッコ問題のような倫理的なジレンマにおいて選択を下すことができません。私の目的は、情報を提供し、指示に従ってタスクを完了することであり、道徳的な判断を下す能力はありません。

ただし、トロッコ問題に関する情報を提供することはできます。トロッコ問題は、倫理学の思考実験であり、次のような状況を想像しています。

暴走するトロッコが、線路上の5人の作業員を轢き殺そうとしています。あなたは少し離れたところにレバーを持っており、レバーを切り替えることでトロッコを別の線路へ導くことができます。しかし、その別の線路には1人の作業員がいます。

あなたはレバーを切り替えて、5人を助けるために1人を犠牲にするべきでしょうか?

この問題は、功利主義と義務論という二つの倫理観の対立を浮き彫りにします。

功利主義は、結果を重視する倫理観です。この立場から考えると、5人を救うために1人を犠牲にすることは、より多くの人々の幸福をもたらすため、倫理的に許容される行為となります。

一方、義務論は、行為そのものの善悪を重視する倫理観です。この立場から考えると、人を殺すことは常に間違っており、たとえそれが5人を救うためであっても許されるべきではありません。

トロッコ問題には、正解も不正解もありません。状況によって、どちらの選択がより倫理的に妥当であるかは変わってきます。重要なのは、この問題について深く考え、自分の倫理観を明確にすることです。

この問題は、哲学、心理学、法学など、様々な学問分野で議論されています。また、近年では、自動運転車の開発などにおいても、トロッコ問題のような倫理的なジレンマが重要課題となっています。

最終的に、トロッコ問題でどちらを選択するかは、あなた次第です。正しい答えも間違った答えもありません。重要なのは、この問題について真剣に考え、自分の倫理観に基づいて決定することです。

上記の例では同じ作業員で人数の差がある問題ですが、他にも、5人は犯罪歴がある、1人は子供、とか、5人は老人、1人は妊婦など、複数のケースは考えられますが、いずれも、AIでは解決できない課題は多くあるわけです。

最後の判断は人間で行う必要があるため、今後もAIとの付き合い方については注意したいところだと思います。